9月26日上午,山东第一医科大学(山东省医学科学院)医学人工智能与大数据学院邀请丹麦奥尔堡大学助理教授张淼博士做客智能医学讲堂,带来专题报告《自动的、高效的、可解释的深度学习模型构建的研究》,分享深度学习方面的前沿研究与最新进展。

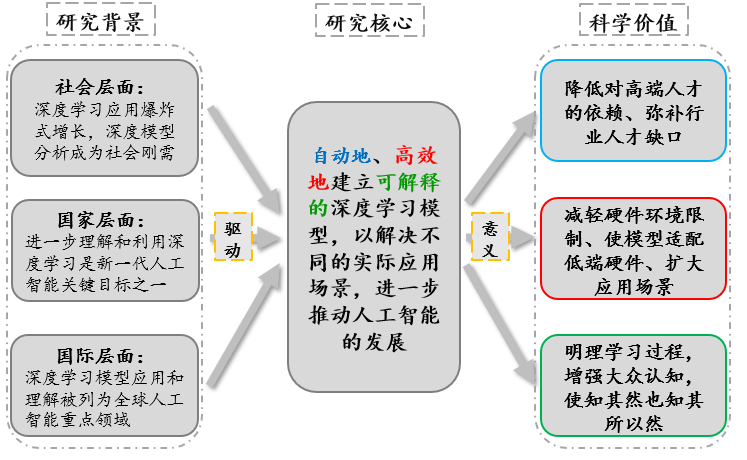

张淼首先从宏观上讲解了深度学习的研究背景和科学价值,介绍了其近年针对深度学习模型设计费时费力、搜索过程计算复杂,硬件依赖度高、深度学习模型解释不清等科学问题展开研究,旨在基于数据驱动、高效地建立可解释的深度学习模型以解决不同模态信息的应用场景。

其后,对以下3个问题进行了阐述:

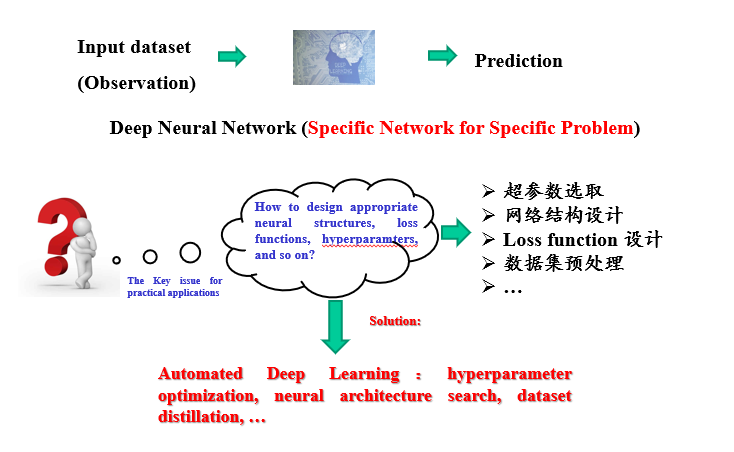

1. 自动深度学习

随着深度神经网络的不断发展,各种模型和新颖模块的不断发明利用,人们逐渐意识到开发一种新的神经网络结构越来越费时费力。为缓解深度学习模型设计繁琐的问题,张淼博士创新性地使用了权重共享网络结构搜索。此方法一般分为两步:首先训练一个超网络,随后利用搜索算法(如进化算法,强化学习,随机搜索)在离散空间搜索。需要注意的是,与早期的NAS不同之处是,网络结构的性能不再需要train-from-scratch,而是直接从超网络继承权重。此方法缓解了繁杂的网络设计过程。

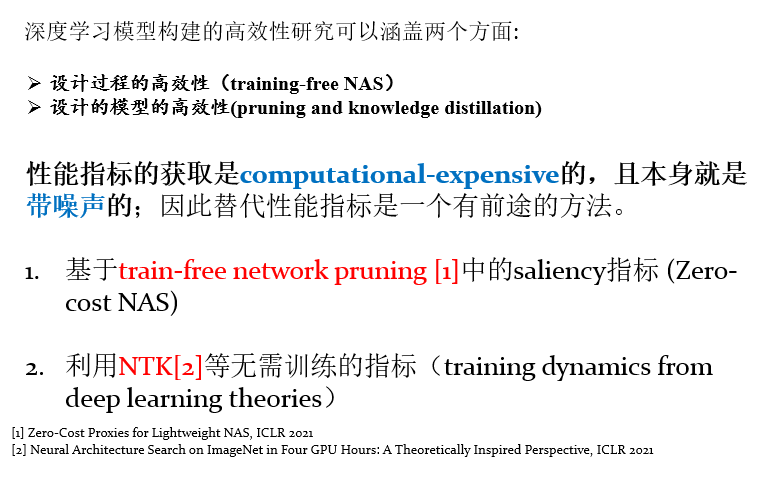

2. 高效的深度学习模型构建

深度神经网络在人工智能的应用中,包括语音识别、计算机视觉、自然语言处理等各方面,在取得巨大成功的同时,这些深度神经网络需要巨大的计算开销和内存开销,严重阻碍了资源受限下的使用。面对此问题,张淼博士提出利用train-free network pruning 中的saliency指标 (Zero-cost NAS)和利用NTK等无需训练的指标(training dynamics from deep learning theories)来代替性能指标是一个有前途的方法。此方法大大减少了搜索复杂神经网络模型的训练复杂度,是的这些方法能够适配低端硬件。

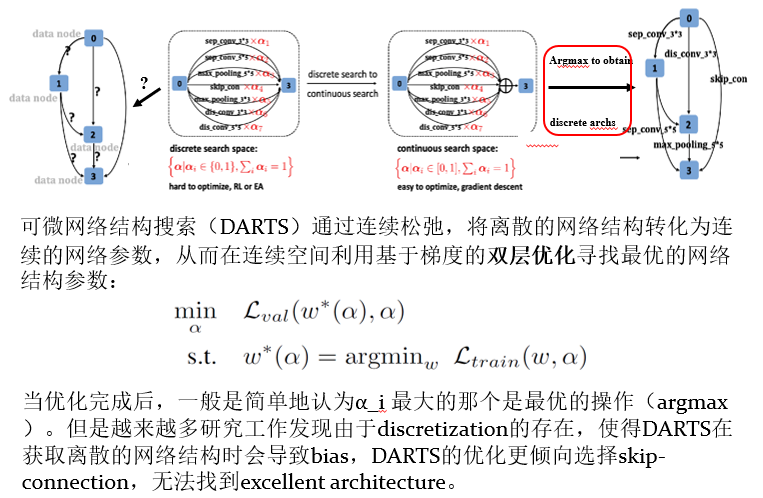

3. 可解释的深度学习模型构建

当我们需要机器为关系到人类生命健康、财产安全等重要任务给出预测和决策结果时,模型的可解释性成为了决定用户是否能够信任这些模型的关键因素。为此,张淼博士尝试理论分析DARTS的最后一步——离散化,通过对损失函数中的参数变化量进行二阶泰勒展开,从数学上解释了搜索结果的合理性。

报告的最后,在座的科研工作者和学生就深度学习的应用、学习模型与数据的问题与张淼教授进行了交流与讨论。

报告人简介

张淼,博士,丹麦奥尔堡大学计算机学院助理教授。主要从事机器学习和人工智能方向,涉及领域包括自动机器学习(AutoML),深度学习,贝叶斯优化,知识蒸馏,可解释人工智能。主持及参与欧美多个国家级科研项目,承担项目总经费达三千万元人民币,研究成果应用到了美国国防部、澳大利亚AtCor公司、丹麦电力系统中。发表相关论文30余篇,其中一作发表CCF A类会议或IEEE/ACM汇刊10篇。长期担任ICML, NeurIPS, ICLR, CVPR, ECCV, IJCAI, AAAI, IEEE TIP, IEEE TNNLS, IEEE TKDE等顶级会议和期刊PC member或审稿人。